Revista Latina de Comunicación Social. ISSN 1138-5820 / No. 82 1-30.

Imágenes falsas, efectos reales. Deepfakes como manifestaciones de la violencia política de género

Fake Images, Real Effects: Deepfakes as Manifestations of Gender-based Political Violence

Almudena Barrientos-Báez. Universidad Complutense de Madrid. España.

Teresa Piñeiro Otero. Universidade da Coruña. España.

Denis Porto Renó. Universidade Estadual Paulista. Brasil.

Este artículo es resultado del proyecto “AGITATE: asimetrías de género en la comunicación política digital. Prácticas, estructuras de poder y violencias en la tuitesfera española” financiado por el Instituto de las Mujeres (Convocatoria de subvenciones públicas destinadas a la realización de investigaciones feministas, de género y sobre mujeres, 2022).

Cómo citar este artículo

Barrientos-Báez, Almudena; Piñeiro-Otero, Teresa y Porto Renó, Denis (2024). Imágenes falsas, efectos reales. Deepfakes como manifestaciones de la violencia política de género [Fake Images, Real Effects: Deepfakes as Manifestations of Gender-based Political Violence]. Revista Latina de Comunicación Social, 82, 1-30. https://doi.org/10.4185/rlcs-2024-2278

RESUMEN

Introducción: El estudio aborda la problemática de los deepfakes y su efecto en la percepción pública, destacando su evolución desde prácticas antiguas de manipulación visual hasta convertirse en herramientas avanzadas de construcción de realidades alternativas, especialmente lesivas para las mujeres. El uso de la manipulación de imágenes como una forma ataque o represión va a llevar a considerar esta práctica como parte de las violencias contra las mujeres en política. Metodología: Este estudio de carácter exploratorio va a adentrarse en el uso de las imágenes manipuladas contra las políticas. Un objetivo para el que se diseñó una metodología múltiple: entrevistas con mujeres políticas, análisis de imágenes falsas auditadas por verificadores de información y búsqueda simple en plataformas de contenidos para adultos. Resultados: Se pone de manifiesto un empleo de imágenes fake como forma de atacar y desprestigiar a las mujeres política. Dichas imágenes son fundamentalmente cheapfakes. Discusión: La limitada sofisticación en la manipulación de imágenes de mujeres políticas permite la detección de falsificaciones por una audiencia crítica. Conclusiones: Las conclusiones resaltan la necesidad de educación mediática para combatir la desinformación y el sesgo de confirmación. La investigación enfatiza la violencia de género en la política, donde los deepfakes se utilizan para silenciar y desacreditar a las mujeres, perpetuando así la misoginia y el mantenimiento de estructuras de poder existentes.

ABSTRACT

Introduction: The study addresses the issue of deepfakes and their effect on public perception, highlighting their evolution from ancient practices of visual manipulation to becoming advanced tools for constructing alternative realities, particularly harmful to women. The use of image manipulation as a form of attack or repression leads to considering this practice as part of violence against women in politics. Methodology: This exploratory study delves into the use of manipulated images against female politicians. For this purpose, a multiple methodology was designed: interviews with female politicians, analysis of fake images audited by fact-checkers, and simple searches on adult content platforms. Results: The study reveals the use of fake images as a way to attack and discredit female politicians, predominantly consisting of cheapfakes. Discussion: The limited sophistication in the manipulation of images of female politicians allows for the detection of forgeries by a critical audience. Conclusions: The conclusions underscore the need for media literacy to combat misinformation and confirmation bias. The research emphasizes gender violence in politics, where deepfakes are used to silence and discredit women, thus perpetuating misogyny and the maintenance of existing power structures.

Keywords: deepfake; image manipulation; misogyny; politics; disinformation; pornography; violence against women in politics.

1. INTRODUCCIÓN

Se escucha el tema del Equipo A (A-Team, Universal Television). Con la famosa cabecera de la serie, que forma parte del imaginario de una generación, se presenta a los protagonistas que –gracias a un usuario Github (Iperov)– muestra los rostros de los principales candidatos a la presidencia del Gobierno de España en los comicios de 2019. El “Equipo E- de España” es un deepfake humorístico del canal de YouTube Face to fake. Entre los vídeos de este canal, se encuentran diversas producciones que toman como base secuencias célebres –memes audiovisuales (Dawkins, 2006)– para la sátira política. Así, un rudimentario deepfake sitúa al expresidente español, Mariano Rajoy como protagonista de Pulp Fiction (Tarantino, 1994), o a Vladímir Putin y Volodímir Zelenski como Jerjes y Leónidas en 300 (Snyder, 2007) por la magia de aplicaciones como DeepFaceLab o SberSwap.

Pero no son los únicos ejemplos, los resultados de las elecciones generales de julio de 2023 inspiraron un deepfake con la famosa secuencia del búnker en El Hundimiento (Hirschbiegel, 2004), en la que Hitler y su camarilla integran los rostros faciales de políticos de la formación de extrema derecha VOX, así como de personalidades de ámbito de la comunicación, con expresiones de gran realismo.

Lo irreal del contexto, la secuencia audiovisual y la comicidad del supuesto discurso de Santiago Abascal (candidato a la presidencia por VOX) aka Hitler, advierten a la posible audiencia del carácter elaborado de este discurso. Sin embargo, no siempre es así.

Figura 1: Fotogramas de la recreación de “El hundimiento” de David Ruiz.

Fuente: @ecamcito.

En 2018 el cineasta Jordan Peele y BuzzFeed crearon un deepfake de Barak Obama, utilizando FaceAPP, en el que llamaba al presidente Trump estúpido (President Trump is a total and complete dipshit). El realismo de este vídeo, que el día en que fue publicado alcanzó 100K vistas en YouTube (Patrini et al., 2018), permitía su registro como veraz evidenciando cómo los deepfakes podrían utilizarse para sembrar desinformación (Silverman, 2018). Aunque este caso particular se diseñó como una advertencia pública, puso de relieve la vulnerabilidad de la sociedad ante la tecnología deepfake.

Más recientemente, a través de WhatsApp, circuló un vídeo de la activista medioambiental Greta Thumberg bailando desnuda como una nueva táctica en su cruzada para concienciar sobre la amenaza del calentamiento global. La inteligencia artificial había permitido reemplazar su cara con la de una actriz porno, generando un vídeo de gran realismo que atentaba contra la intimidad y dignidad de la activista, además de burlarse de sus ideas.

Thumberg no ha sido la única víctima de esta práctica, que utiliza herramienta de inteligencia artificial –en muchos casos accesibles desde la propia tienda de Apps móvil– para generar falsas imágenes de desnudos o pornografía. Precisamente Deepfakes fue el nickname del usuario de Reddit que desnudó a actrices y cantantes como Gal Gadot, Emma Watson, Katy Perry, Taylor Swift y Scarlett Johansson (Cerdán y Padilla, 2019).

Coetáneamente a la publicación de estos primeros deepfakes pornográficos aparecían las aplicaciones de transformación facial basadas en inteligencia artificial como FaceApp que, a partir de redes neuronales, modificaban la edad, expresión o género de una cara. Pronto serían secundadas por aplicaciones de reemplazo de rostros como FakeApp o DeepfakeApp que democratizaron la producción de deepfake. Más allá de que el código base para proyectos deepfake esté abierto y accesible en espacios como GitHub (Newton y Stanfill, 2020), la irrupción de estas aplicaciones ha permitido la creación de piezas manipuladas a usuarios carentes de experiencia técnica.

Al cierre de este texto un grupo de menores de entre 11 y 17 años de Almendralejo (Extremadura, España), se descubrían protagonistas de falsos desnudos, creados por sus compañeros con una APP de deepfakes, que circulaban móvil a móvil.

Mientras determinadas plataformas online como el coloso de los contenidos para adultos, PornHub, o el propio Reddit han prohibido o aplicado importantes limitaciones a estos contenidos sintéticos, la comunidad deepfake sigue activa en espacios sin moderación como GitHub (Newton y Stanfill, 2020) y decenas de herramientas para su creación circulan libremente por la Red (Angler, 2021), propagando la invasión de privacidad y la explotación sexual en línea (Beamonte, 2018).

En este sentido los deepfakes deben entenderse como parte del o gendertrolling, término con el que Mantilla (2013) hace referencia a un troleo específico, dirigido a las mujeres. Más allá de la burla o la risa agresiva contra una víctima más o menos fortuita en la Red, más o menos extendido en el tiempo en función de la reacción de la víctima, el troleo de género suele tener en común su carácter misógino, la participación de un elevado número de personas usuarias -habitualmente orquestadas-, su extensión en el tiempo y su especial lesividad. Dentro del troleo de género se integran diversas manifestaciones que van de representaciones hipersexualizadas o memes machistas a intimidación, acoso, amenazas de muerte o violación, que suponen la proyección de violencias existentes en el mundo fuera de línea (Piñeiro-Otero et al., 2023).

Newton y Stanfill (2020) destacan la masculinidad tóxica geek como algo inherente a la comunidad deepfake en GitHub e identifican como elementos caracterizadores su capacidad de abstracción de los sujetos humanos, la disociación respecto al contenido pornográfico y una indiferencia al daño causado. El uso de la tecnología para ejercer el dominio de la masculinidad hegemónica así como la falta de empatía y despersonalización del “Otro” (en este caso de la “Otra”) alinea a los deepfakers con los troles de género.

El troleo de género debe situarse en un nuevo blacklash antifeminista, respuesta a la Cuarta Ola del Feminismo y, en particular, a la manosfera (Nagle, 2017; García-Mingo et al., 2022), una subcultura misógina en la Red altamente reactiva a las cuestiones de género y a la expresión pública de las mujeres, que funciona como una suerte de inteligencia colectiva digital (Levy, 2004) para atacar y silenciar a aquellas mujeres que se manifiestan públicamente (dentro y fuera de la Red), especialmente a aquellas con posicionamientos a favor de la igualdad o que denuncian las violencias machistas. Esta particularidad sitúa a las mujeres políticas -entendiendo como tal a líderes, representantes y candidatas de partidos políticos, pero también a activistas- en el punto de mira de estos troles (Piñeiro-Otero y Martínez-Rolán, 2021).

Cole (2015) señala la existencia de similitudes entre el troleo y la retórica disciplinaria, en tanto que los troles ejercen prácticas violentas contra las mujeres para disuadirlas y disciplinarlas, situando el cuerpo como centro del control, así como eje central del discurso en muchas de las prácticas de troleo de género (por ejemplo, todas aquellas manifestaciones de violencia sexual digital, desde la pornovenganza a la difusión imágenes íntimas).

Aun cuando autores Paananen y Reichl (2019) han constatado que la diversión supone una de las principales motivaciones también para los troles de género, Lone y Bhandari (2018) inciden en que cuando el trolling supone un acto organizado con un propósito ideológico, se convierte en un intento deliberado de silenciar las voces disidentes. Como defiende Manne (2018) la misoginia supone, en sí misma, un fenómeno político.

En este sentido el objeto del presente trabajo ha sido el de analizar el uso fraudulento de la imagen como una forma de troleo de género contra las mujeres políticas. Se parte de la hipótesis de que la manipulación de la imagen (estática o audiovisual), ya como burla ya como desinformación, busca minar la reputación y credibilidad de líderes, representantes y candidatas y -por tanto- debe entenderse como una manifestación de la violencia contra las mujeres en política.

2. Profundizando en el fenómeno de los Deepfakes: implicaciones sociales y políticas

2.1. El tratamiento de la imagen

La palabra “fotosó”, derivada del famoso programa de tratamiento fotográfico Photoshop (tienda de fotos), se ha popularizado para hacer referencia a cualquier retoque fotográfico. Esta manipulación supone una práctica habitual, incluso inconsciente en el caso de los filtros inteligentes, fluctuando entre lo abiertamente incongruente y lo intencionadamente engañoso (Thomas, 2014; Winter y Salter 2019).

La evolución tecnológica y, más concretamente, de la inteligencia artificial ha favorecido la sofisticación de estas prácticas. Del retoque automático de imágenes, presente en las aplicaciones de cámara en smartphones a fórmulas más complejas como los deepfakes, el contexto actual ofrece un extenso panorama de desafíos y oportunidades por explorar (Chesney y Citron, 2018).

Los deepfakes –término que hace referencia al aprendizaje profundo– suponen una de las evoluciones más significativas de la manipulación digital. Este fenómeno ha inundado medios de comunicación y redes, integrándose en el entramado de la cultura algorítmica actual (Hallinan y Striphas, 2016; Jacobsen y Simpson, 2023). Su aplicación inicial la transposición de rostros de mujeres en cuerpos ajenos, tiene en la pornografía un terreno fértil (Compton, 2021). Se trata de una invasión de la privacidad que ha favorecido el debate ético y legal en torno a estas creaciones (Ajder et al., 2019) al margen de las adiciones patológicas que su uso puede generar (López et al., 2023).

Para Kietzman et al. (2020) los deepfakes han redefinido la manipulación de imágenes al permitir la superposición y generación hiperrealista -y prácticamente imperceptible- de contenidos en vídeo-audio. Más allá de un público híper-especializado su producción se encuentra al alcance de la ciudadanía. Desde las tiendas de aplicaciones móviles se puede descargar multitud de las APP Freemium como Reface que permite el reemplazo de rostros en un vídeo con solo tocar un botón.

La posible verosimilitud de estas manipulaciones atenta con la idea de la imagen como prueba irrefutable, generando cierta preocupación respecto a su uso en el marco de desinformación al tiempo que transforman la verdad en una realidad mutable (Schick, 2020; Yadlin-Segal y Oppenheim, 2021). La fluidez y familiaridad de los deepfakes favorece su recepción, con independencia de su veracidad, agudizando este fenómeno (Vaccari y Chadwick, 2020).

La evolución tecnológica en este ámbito ha desencadenado una ola de material explícito y engañoso en Internet así como la demanda de regulaciones más rigurosas que traten la creación e identificación de estas producciones digitales, así como de herramientas más avanzadas para su detección (Patrini et al., 2018).

De hecho –como afirma Temir (2020)– la notoriedad pública de los deepfakes se incrementó tras la aparición de vídeos de personalidades públicas en situaciones comprometidas o falsas; como advertía Mark Zuckerberg generado por inteligencia artificial, los deepfakes pueden generar desinformación y alterar percepciones (Posters, 2019), erosionando la confianza en los medios, las instituciones y amenazando la integridad de los procesos democráticos (Diakopoulos y Johnson, 2020).

Sin embargo, no todo es negativo. En febrero de 2020, en vísperas de las elecciones a la asamblea legislativa de Delhi, se hacía viral un vídeo del político indio Manoj Tiwari hablando haryanvi (uno de los más de mil seiscientos dialectos que se hablan en la India) por obra de la inteligencia artificial. Este deepfake, que alcanzó a quince millones de personas, supuso el primer ejemplo de su uso para la comunicación electoral (del Castillo, 2020).

En su creación se desarrollaron tres de las técnicas que Farid et al. (2019) identifican en la creación de deepfakes:

- Reemplazo de caras o cambiar el rostro de una persona por otra.

- Réplica de expresiones faciales, que suelen aportar realismo a la copia además de interpretar y vocalizar un discurso falso.

- Síntesis de voz, que permite crear una infraestructura capaz de reproducir cualquier texto con las características vocales y prosódicas del modelo original.

Estos autores señalan una categoría adicional –la generación de rostros, proceso que permite la creación de caras ex novo– entre las prácticas más frecuentes de producción.

La democratización de aplicaciones para la producción de estas imágenes sintéticas ha facilitado su creación y potenciado su circulación que, más allá de plataformas como Reddit o páginas específicas como MrDeepfakes o AdultDeepfakes, hoy se inmiscuyen en la cotidianidad de las personas a través de WhatsApp.

Situados en un punto crítico entre la innovación tecnológica y social, los deepfakes vuelven a poner de actualidad el clásico debate respecto a los límites de la expresión creativa y de la protección de la verdad y la privacidad individual; de las instituciones, la seguridad y los derechos personales (Jacobsen y Simpson, 2023; Vaccari y Chadwick, 2020; Chesney y Citron, 2018).

2.2. Deepfake y desinformación

En el contexto actual la posverdad se ha situado como un elemento disruptivo en la esfera sociopolítica, desdibujando las fronteras entre la realidad objetiva y la construcción ficticia (Keyes, 2004). Prácticas como el clickbait, titulares generados para atraer a las personas usuarias (García-Orosa et al., 2017), la preeminencia algorítmica de los mensajes más impactantes o radicales en redes sociales (Bellovary et al., 2021), la proliferación de pseudomedios de comunicación (Rodríguez-Fernández, 2021) y la polarización política, generan un terreno propicio para el auge de la desinformación en el que la propia noción de verdad carece de relevancia.

El concepto de "posverdad" cobró relevancia en el escenario global en el año 2016, coincidiendo con el referéndum sobre el Brexit y las elecciones presidenciales de Estados Unidos, lo que llevó a su selección como palabra del año por el Oxford English Dictionary. Ambos eventos políticos, la salida de Reino Unido de la Unión Europea y la tumultuosa carrera presencial de Donald Trump, estuvieron impregnados de narrativas que a menudo dejaban la precisión factual en detrimento de estrategias retóricas que apelaban a las emociones viscerales de la ciudadanía (McComiskey, 2017; Mula-Grau y Cambronero-Saiz, 2022).

En un contexto cada vez más complejo y polarizado se ha incrementado la circulación de información falsa, parcial o engañosa, amplificada por diferentes agentes -políticos, mediáticos, etc.-, en especial a través de las redes sociales (Barrientos-Báez et al., 2022) que buscan incidir y lograr una opinión pública favorable.

El brote y gestión de la COVID-19 llevó a una infodemia que dificultó la localización de fuentes y contenidos fiables (Román-San-Miguel et al., 2020; Orte et al., 2020; Alonso-González, 2021; Renó et al., 2021; Barrientos-Báez et al., 2021; López-del-Castillo-Wilderbeek, 2021; Martínez-Sánchez, 2022; Román-San-Miguel et al., 2022; Nuevo-López et al., 2023), lo que generó el terreno propicio para la desinformación y los rumores, la manipulación interesada de la información, que se propagaron como virus a través de las redes sociales (Organización Panamericana de la Salud, 2020) aunque existiesen precedentes prepandémicos (Encinillas-García y Martín-Sabarís, 2023).

La elevada penetración de los dispositivos móviles conectados y los social media ha propiciado la expansión de información falsa o distorsionada entre una audiencia muy amplia (Sim, 2019), que cada vez más relega en los algoritmos –de redes sociales, motores de búsqueda o agregadores de noticias– su consumo informativo. Siguiendo el Digital News Report (Amoedo, 2023) en España el 56% de las personas menores de 44 años ya tienen en las redes sociales su principal fuente de información, aunque esto también posee una cara amable (Vázquez-Chas, 2023) o útil (Abuín-Penas y Abuín-Penas, 2022) en las crisis como la de la pandemia de la COVID-19 que no debemos olvidar.

Esta manipulación informativa adopta formas sofisticadas, como el uso intensivo de bots y trolls, que se han convertido en elementos fundamentales en las campañas de desinformación en el vasto mundo de las redes sociales (Cosentino, 2020).

En medio de la evolución tecnológica, la distinción entre contenidos genuinos y fabricados se ha tornado una tarea compleja máxime en el caso de los deepfakes, artefactos digitales capaces de recrear escenarios y alterar el registro visual, haciendo que clones virtuales aparezcan en situaciones o pronuncien discursos no vividos por su referente –persona– real (Westerlund, 2019). La amenaza democrática que suponen estos tipos de prácticas ha llevado a empresas como Facebook a prohibir este tipo de contenidos especialmente durante períodos electorales críticos (Facebook Newsroom, 2020). Google, en su lucha contra la desinformación, lanzó “Assembler” un modelo para detectar imágenes falsas, manipuladas y deepfakes (Hao, 2022; Barca, 2020).

Pero el problema trasciende los deepfakes. La desinformación adopta múltiples disfraces, desde citas mal atribuidas hasta imágenes digitalmente alteradas y contextos fabricados, contribuyendo a un ecosistema donde la verdad se vuelve esquiva y maleable (Almansa-Martínez et al., 2022). En el escenario de la comunicación política, las plataformas que perpetúan estos contenidos fraudulentos han tomado un papel central, forjando realidades paralelas que se fortalecen en la esfera digital (Rodríguez-Fernández, 2021).

Un ejemplo que captó la atención mundial fue los vídeos fake de Nancy Pelosi, política demócrata y presidenta de la Cámara de Representantes en Estados Unidos, editados para que pareciese que hablaba de manera errática, con dificultades de dicción y con la voz afectada. Ambos vídeos, compartidos por el entonces presidente Donald Trump y Rudy Giuliani (ex alcalde de Nueva York) parecían remitir a una Pelosi aquejada de síntomas etílicos lo que provocó una percepción pública gravemente tergiversada (Gómez-de-Ágreda et al., 2021; Harwell, 2019).

Ante este alud de desinformación la verificación de datos se conforma como un componente esencial del proceso informativo (López-Borrull et al., 2018; Ufarte-Ruiz et al., 2022). Las tecnologías emergentes, desde la minería de datos en redes sociales hasta la realidad virtual, están remodelando la forma en que interactuamos con la información (Barrientos-Báez y Caldevilla-Domínguez, 2022) y presentan tanto oportunidades como amenazas en esta lucha continua por la veracidad de las fuentes (Manfredi-Sánchez, 2021; Miller, 2020).

En un momento de intensa polarización (Garmendia et al., 2022), en que las cuestiones de género se han convertido en tropos polarizadores del discurso político (García Escribano, et al., 2021), reflejo de una reacción antifeminista que se extiende por plataformas y espacios en línea (Ging y Siapera, 2019), el factchecking supone una fórmula de excepción para evitar que las falsas narrativas misóginas calen en la ciudadanía y alteren su percepción de la realidad (Piñeiro-Otero y Martínez-Rolán, 2023).

2.3. Deepfakes en la arena política

Uno de los ámbitos en los que los deepfakes cuentan con mayor alcance y notoriedad es el de la política ya que es muy sensible a la información que circula por los nuevos canales comunicativos: las redes sociales, donde lo 2.0 ya es residente habitual (Caldevilla-Domínguez, 2014). La importancia de la imagen pública y la credibilidad en los agentes políticos los hacen especialmente vulnerables a esta forma de ataque, pero también puede afectar a la estabilidad del proceso político en su conjunto.

En el actual clima de polarización y de tensión continua que vive la política (Fiorina et al., 2006), se ha extendido el uso de información incorrecta, falsa o inexacta para sustentar ideas y/o argumentos. Así, en el contexto español, los debates televisivos de candidatos y líderes políticos previos a las elecciones generales de julio de 2023 situaron a entidades de verificación como Maldita o Newtral en agentes esenciales en el entramado electoral, dada la capacidad del factchecking en influir significativamente en la actitud y evaluación de las candidaturas (Wintersieck, 2017).

La generación de contenidos sintéticos supone un cambio disruptivo al crear eventos y declaraciones que nunca ocurrieron. Apenas un mes del inicio de la Guerra entre Rusia y Ucrania se hacía público un vídeo deepfake del presidente Volodymyr Zelensky llamando a la rendición del ejército y el pueblo ucraniano. Aunque el vídeo presentaba una burda factura, y después de su eliminación por Meta y YouTube (Jacobsen y Simpson, 2023), su difusión puso de manifiesto la erosión de la confianza en los medios auténticos (Wakefield, 2022).

Figura 2: Deepfake del presidente de Ucrania pidiendo la rendición del pueblo Ucraniano.

Fuente: Verify.

Estos contenidos sintéticos han alcanzado un nivel de sofisticación tal que las declaraciones fabricadas son casi indistinguibles de las reales, lo que ha llevado a poner el foco en su capacidad de alterar elecciones dañar relaciones internacionales y socavar la confianza pública (Chesney y Citron, 2018). Así, el deepfake se erige como una evolución alarmante en la dinámica de las fake news. Aunque todavía no han tenido una presencia destacada en campañas electorales (Raterink, 2021), la posibilidad de generar estos contenidos sintéticos añade una capa de complejidad a la forma en que la información se genera y se consume en la sociedad.

Hoy la desinformación se ha transformado en una estrategia política para para alterar la opinión pública pero también para desacreditar y deslegitimar a oponentes (Shao, 2020; Farkas y Schou, 2018). Ejemplo ello son los vídeos manipulados de Nancy Pelosi (2019) o Patricia Bullrich (2020) –exMinistra de Seguridad argentina y una de las líderes de la coalición Juntos por el Cambio– que simulan estados de embriaguez o incompetencia, con el fin de desacreditarlas políticamente. A pesar de que el término deepfake ha pasado a denominar cualquier pieza audiovisual manipulada digitalmente, en el caso concreto de Pelosi y Bullrich se trata de shallowfakes: alteraciones desinformativas de piezas de vídeo preexistentes para validar una no-verdad (Randall, 2022).

Bakir y McStay (2018) describen este fenómeno como un "significado flotante", donde las noticias falsas se han convertido en una herramienta flexible y estratégicamente adaptada para moldear la percepción pública y establecer agendas políticas. Estas tácticas se han infiltrado incluso en medios reputados The Washington Post, The Guardian o The New York Times, complicando la capacidad ciudadana de discernir entre la realidad y la fabricación (Farkas y Schou, 2018). Así, como señalan Farkas y Schou (2018) los deepfakes refuerzan discursos recurrentes que apoyan agendas específicas, marcando una nueva frontera en la que la verdad es más esquiva que nunca.

Vaccari y Chadwick (2020) ponen de relevancia que más que engaños directos –en algunos casos la calidad de la manipulación facilita su identificación como falsos– los deepfakes tienen el riesgo de alimentar la indeterminación y cinismo de la sociedad, suponiendo un desafío para la cultura cívica en línea.

Más allá de la desinformación, la preocupación radica en cómo los deepfakes pueden alterar la percepción de la realidad objetiva, fomentando realidades subjetivas alimentadas por 'hechos' fabricados (Chesney y Citron, 2018).

La emergencia de deepfakes, por tanto, no debilita las bases de hechos y verdades compartidos, sino que recuerda que las nociones de democracia nunca han sido fijas (Heemsbergen et al., 2022). En este contexto, como afirman Jacobsen y Simpson (2023), los deepfakes no son un fenómeno desestabilizador, sino un reflejo de la naturaleza siempre contestada de la política.

2.4. Deepfakes y la explotación pornográfica

Desde su primera aplicación desnudando a actrices y otras celebridades, el porno se ha consolidado como principal territorio para los deepfakes. Un estudio desarrollado en 2019 por DEEPTRACE concluyó que un 96% de los deepfakes audiovisuales en circulación era pornografía basada en la superposición de rotros de mujeres –en su mayoría famosas como Kristen Bell y Gal Gadot (Angler, 2021)– sobre cuerpos de actrices porno por obra de la inteligencia artificial. Esta intensa producción deepfakes pornográficos volvió a ponerse de manifiesto en un informe reciente publicado por Home Security Heroes, 2023. Este reemplazo ha dado lugar a una nueva forma de abuso sexual digital que, además de no contar con el consentimiento de las “protagonistas” resulta especialmente intrusivo.

Como señala van der Nagel (2020), casi la totalidad de estos vídeos sintéticos comprometen a mujeres en actos no consensuados, lo que supone una usurpación de su agencia así como un atentado contra su privacidad e intimidad. Aquí, los deepfakes son más que imágenes: son armas que refuerzan la objetivación y la mirada patriarcal (Mulvey, 1989), haciendo que los cuerpos femeninos sean únicamente meros materiales al servicio de las fantasías masculinas (Denson, 2020). Aun cuando se trata de clones digitales la integración en estos contenidos sintéticos despoja a las mujeres de su representación visual así como de sus entorno social, cultural y físico, produciéndose una disonancia profunda ente la experiencia vivida por las mujeres (la realidad) y las maneras en las que son visualmente representadas y manipuladas mediante algoritmos (Denson, 2020).

La manipulación de imágenes con fines pornográficos, incluso como parte de violencias sexuales como la sextorsión o la pornovenganza hacia mujeres anónimas, no es un fenómeno nuevo. Hayward y Rahn (2015) sitúan sus comienzos a mediados de la década de los 90, coincidiendo con la democratización de software de edición de imágenes, una labor que ha dado un salto cualitativo con la integración de la inteligencia artificial en la producción y distribución de porno no consensuado.

Los estrechos vínculos entre la comunidad deepfake y la manosfera se hacen patentes en plataformas como Reddit en las que usuarios anónimos debaten y comparten, a modo de comunidad de aprendizaje, respecto al uso de fotografías de exnovias en situaciones sexualmente explícitas (Hayward y Rahn, 2015) permiten avanzar un crecimiento exponencial de estos contenidos (Morris, 2018).

Mientras tanto, la investigación para lograr un mayor realismo en estos contenidos sintéticos avanza, centrándose en la precisión algorítmica y la perfección representacional más que en sus implicaciones éticas. Una vez más se propone una perspectiva neutra para un fenómeno -como sucede con otras prácticas digitales- refuerza estructuras de poder y desigualdades de género.

Los deepfakes no son anomalías, sino extensiones de una estructura cultural preexistente, un reflejo de una mirada masculina que –como señalan Brown y Fleming (2020)– ahora se codifica en algoritmos para presentar una realidad que, lejos de la autenticidad de las imágenes, se basa en la perpetuación patriarcal, reforzando las disparidades de poder.

Para Jacobsen y Simpson (2023) los deepfakes podrían definirse con las palabras de Louise Amore (2020) sobre los relatos algorítmicos: “parciales, contingentes, oblicuos, incompletos y sin fundamentos”. Son narraciones defectuosas, pero no aleatorias: son frutos de las tensiones, miedos y estructuras de poder arraigados en nuestro tejido social (Jacobsen y Simpson, 2023).

2.5. Clasificación de imágenes falsas

Los deepfakes, surgidos en plena innovación tecnológica, se han convertido en una herramienta con un poder sin precedentes para moldear la percepción pública y construir realidades alternativas, navegando a través de los océanos de la representación mediática y el activismo digital. En este sentido, su relación con la historia de la manipulación visual no es una anomalía, sino más bien un sucesor evolutivo de prácticas que se remontan a décadas o incluso siglos atrás. La manipulación fotográfica ha sido una herramienta de propaganda extensamente utilizada, trazando un paralelo histórico con los deepfakes de hoy (Jaubert, 1989).

Desde una perspectiva tecnológica, la bifurcación entre deepfakes y cheapfakes está supeditada a la accesibilidad de herramientas y aplicaciones de distorsión de la realidad y –en algunos casos– a la provisión de un conjunto de imágenes que permitan la generación de un clon digital lo más realista posible. La visibilidad de las personalidades públicas y su pegada con cientos de imágenes en la Red, las convierte en víctimas propicias de estas falsificaciones digitales.

La democratización de las aplicaciones de deepfakes es fascinante y alarmante a la vez (Tan y Lim, 2018). Hoy la creación de deepfakes sólo requiere un dispositivo con conexión a Internet, una realidad que –como señalan Gómez-de-Ágreda et al. (2021)– hubiese parecido de Ciencia Ficción hace apenas una década. La respuesta a este fenómeno, sin embargo, no puede limitarse a la detección y moderación tecnológica. Autores como Garimella y Eckles (2020) y Gómez-de-Ágreda (2020) inciden en la necesidad de una recontextualización y análisis crítico de la información.

De hecho, aunque la emergencia de estas tecnologías y su democratización ha expandido el término deepfake como denominación general para cualquier uso fraudulento de la imagen, con independencia de la intervención de la inteligencia artificial en el proceso o el tratamiento implícito en la representación falsa o parcial de la “realidad”. En este sentido resulta preciso incidir en que más allá de cualquier manipulación técnica, la propia selección de la toma, el encuadre o la identificación con otro momento/lugar respecto del original son prácticas habituales en la desinformación.

Autores como Paris y Donovan (2019), Garimella y Eckles (2020) o Gómez-de-Ágreda et al. (2021) desgranan estas prácticas de manipulación de imágenes (estáticas audiovisuales), desde la descontextualización, que busca una lectura interesada sobre la imagen a través del encuadre o una atribución errónea, a la sofisticación tecnológica de los deepfakes audiovisuales.

En esta línea, Gómez-de-Ágreda et al. (2021) proponen una clasificación intensiva de las formas contemporáneas de manipulación desinformativa de imágenes. Categorización que sugiere una gradación de estas manifestaciones:

- Imágenes descontextualizadas. Utilización de dobles o la atribución del contenido de la imagen a un momento o lugar diferente del contenido digital. Se trata de una táctica frecuente de desinformación que ha favorecido la circulación periódica de imágenes de archivo como instantáneas de un evento de actualidad.

- Imágenes parciales. Aquellas que, aun manteniendo el contexto, presentan una visión parcial de la realidad -encuadre o perspectiva interesada, recorte de la imagen, etc.- que propicia una lectura errónea de lo mostrado. En este sentido, Gómez-de-Ágreda et al. (2021) defienden la consideración de estas imágenes como una categoría diferencia respecto a las descontextualizadas.

- Imágenes/vídeos retocados, incluyendo alteraciones de velocidad que pueden llevar a sugerir lecturas erróneas de la realidad. El vídeo retocado de Nanci Pelosi o de la Ministra de Seguridad Pública Argentina, para sugerir un posible estado de embriaguez, por ejemplo, entrarían dentro de esta categoría.

- Imágenes/vídeos alterados digitalmente, a través de programas de retoque. Suponen un paso más en esta manipulación al afectar a la representación visual, es decir, a los píxeles de las imágenes.

Fuente: Newtral.

Fuente: El País y EFE.

Figuras 6-7: Retoque de pixeles en las manifestaciones del 1 de octubre de 2017.

Fuente: @VictorRomeroEC.

Cuanto esta alteración digital implica a redes neuronales convolucionales o generativas, para generar cambios profundos, e produce un salto cualitativo en cuanto a su sofisticación y potencial disruptivo. Estos autores proponen el desglose de la categoría de deepfake en dos:

• Retoque de imágenes preexistentes –por ejemplo el reemplazo de cara o la réplica de expresiones faciales–. Esta es la manifestación más habitual de deepfakes, tanto en el ámbito de la pornografía como en el de la política o la desinformación –como sucedió en el caso del Presidente Ucranio– con aplicación también en ámbitos como el humor o la publicidad. Ejemplo de ello es la campaña de Cruzcampo “Con mucho acento” protagonizada por una Lola Flores sintética gracias a técnicas de reemplazo facial.

• Creación ex novo de imágenes GAN –generative adversarial network– de gran realismo en su representación (Hartman y Satter, 2020). En 2019 Phillipg Wang desarrolló un código basado en el algoritmo de Nvidia al que bautizó como StyleGAN. Este código dio lugar a la web ThisPersonDoesNotExist.com, que genera caras falsas extremadamente realistas a través de generative adversarial network. Estas imágenes son indistinguibles, como constataron Nightingale y Farid (2022), e incluso pueden generar más confianza que las reales.

Figura 8: Fotograma del vídeo publicitario de Cruzcampo “Con mucho acento” desarrollado por Ogilvy y postproducida en Metropolitana.

Fuente: Panorama Audiovisual.

Figuras 9-11: Imágenes GAN generadas automáticamente por ThisPersonDoesNotExist.com

Fuente: ThisPersonDoesNotExist.com

La explosión y democratización de las diferentes formas de manipulación de la imagen han favorecido un cambio en su concepción como reflejo fehaciente de la realidad. En la actualidad enfrentamos un contexto donde las imágenes forman una parte importante de la desinformación. Deepfakes pero –sobre todo– descontextualización, imágenes parcialmente veraces u otras manipulaciones para distorsionar la interpretación de los hechos, suponen prácticas recurrentes en la diseminación de información (Krizhevsky et al., 2017). Así, las fotografías y vídeos se han convertido en una parte central del trabajo de los verificadores de información.

Si bien en algunos casos la tarea de estos factcheckers resulta tan sencilla como efectuar una búsqueda inversa en Google, o revisar otras instantáneas del mismo evento, la introducción de la inteligencia artificial complejiza esta tarea hasta hacerla prácticamente imposible.

La sofisticación en la alteración de la realidad de estos métodos, donde las tecnologías como las redes neuronales convolucionales y los métodos sintéticos, está remodelando la frontera de lo posible (Barnes y Barraclough, 2019). La celeridad en el desarrollo y en la penetración de estas tecnologías en nuestro consumo mediático (Gerardi et al., 2020), las convierte en una amenaza sin precedentes por su habilidad para replicar la realidad hasta un grado indistinguible (Gómez-de-Ágreda et al., 2021).

2.6. Empleo misógino en el ámbito de la política

Dentro del campo político y social la emergencia de deepfakes y otras formas de manipulación de imagen, así como su potencial viral a través de plataformas sociales, suponen un atentado contrainformativo. En un contexto en el que las redes sociales se han posicionado como principales fuente de información en determinados grupos etarios (Amoedo, 2023) se genera el campo propicio para la desinformación, máxime de tener en cuenta fenómenos de restricción informativa propios de estos ambientes online como la cámara eco o el filtro burbuja (Piñeiro Otero y Martínez Rolán, 2021).

Estas imágenes alteradas, especialmente aquellas con una carga emotiva elevada, se convierten en un contenido perfecto para un consumo y distribución rápida, casi irreflexiva, fomentando la polarización política y socavando la confianza en medios e instituciones (Fard y Lingeswaran, 2020).

En un contexto de blacklash antifeminista, en el que las cuestiones de género se han convertido en tropos polarizadores del discurso político (García Escribano et al., 2021)., resulta preciso incidir en la existencia de una desinformación de género que se va a hacer presente también en diversas formas de manipulación de imagen. Este tratamiento debe entenderse dentro del troleo de género y, por tanto, como parte de un discurso de odio misógino que, si bien puede tener su origen en la manosfera, se expande u alimenta del sexismo ambiental imperante dentro y fuera de la Red, y en especial de una reacción conservadora a los avances de las mujeres en los espacios públicos.

Esta manosfera supone una multitud inteligente, en la línea señalada por Rheingold (2002): se trata de una organización eficiente –tanto del proceso de creación como del flujo de contenido– permitiendo que las personas se conecten entre sí o con otras personas, actuando de forma coordinada para su mayor proyección (y lesividad).

En el caso de las mujeres políticas, las fronteras entre desinformación, política y pornografía los tres principales ámbitos en los que se produce la manipulación de imágenes, se desdibuja.

Así, por ejemplo, Alexandria Ocasio-Cortez congresista estadounidense (la mujer más joven en ocupar este cargo), fue víctima de diferentes manipulaciones de imagen desde un vídeo fake de una supuesta videollamada con Nancy Pelosi y Joe Biden tras el asalto al capitolio, cuyo audio fue manipulado con inteligencia artificial poniendo en su boca (mal sincronizada) improperios a la Presidenta del Congreso y el Presidente de Estados Unidos (Reuters Fact Check, 2023), hasta fotografías en las que pasea de la mano con Elon Musk CEO de Twitter (University of Toronto, s.f.), pasando por decenas de deepfakes porno en los que, por magia de la inteligencia artificial, Ocasio-Cortez performa diversas fantasías sexuales de sus creadores.

Figuras 12-13: Manipulación de imágenes de Alexandria Ocaso-Cortez.

Fuente: University of Toronto y Reddit.

La creación sintética de imágenes y manipulación debe entenderse dentro de una lucha de poder en la que, como señalan Ferrier (2018); Cuthbertson et al. (2019), convergen ideología del odio, misoginia y falsas narrativas.

Esta hostilidad contra las mujeres políticas ha sido analizada como parte de una reacción antifeminista, caracterizado por su extrema misoginia, reactividad y una mayor propensión a los ataques personales (Bonet-Martín, 2020). Como contramovimiento este antifeminismo se caracteriza por su refinada sofisticación discursiva, su notable capacidad para evolucionar y adaptarse a diferentes contextos y por la dialéctica específica que desarrolla en respuesta a las reivindicaciones y manifestaciones feministas (Bonet-Martí, 2021). En este tenor, Ging (2019) advierte sobre un preocupante desplazamiento del activismo a la agresión personalizada, evidenciando un cambio en la naturaleza de los ataques que sufren las mujeres que ocupan espacios de poder y decisión.

No es casualidad que la Alexandria Ocasio-Cortez se haya manifestado como feminista y haya aprovechado sus intervenciones en el Congreso –como la de julio de 2020– para criticar al machismo imperante y la normalización de la violencia y el lenguaje violento contra las mujeres (ElDiario.es, 2020).

La creación, tratamiento y difusión de imágenes de mujeres políticas (en el sentido más amplio de la política) suele orientarse a desprestigiarlas, menoscabar su credibilidad, sus posicionamientos o a inhibir su participación. Así, el objetivo ulterior de los deepfakes pornográficos contra personalidades como la periodista india Rana Ayyub –tras denunciar la violación de una niña–, la activista británica contra la pornografía infantil, Kate Isaacs, o la activista medioambiental Greta Thumbert, es silenciar sus voces críticas (Ayyub 2018; Citron 2019; France 2018; Mohan y Eldin 2019).

Mi trabajo, que incluyó revelar un escándalo en una importante investigación de asesinato, provocó que circularan en línea imágenes mías alteradas en poses sexualizadas. La publicación de mi libro llevó a acusaciones en redes sociales sobre métodos no éticos y relaciones con mis fuentes. Estos eventos me transformaron. La ironía reside en que, justo antes de que saliera el vídeo, había escuchado sobre los riesgos de los deepfakes en la India, término que tuve que buscar en Google. Para mi desgracia, me convertí en víctima una semana después. Opté por el silencio inicialmente, temiendo que hablar del tema solo llevara a una morbosa curiosidad, catapultando la popularidad de los deepfakes. (Ayyub, 2018)

Estas imágenes falsas, producto de la inteligencia artificial y otras formas de manipulación, se han convertido en herramientas para atacar a las mujeres en línea. Su objetivo de silenciarlas lleva a entender estas prácticas como parte de las violencias contra las mujeres políticas en la Red o de la violencia política por razón de género (Hybridas, 2021).

A pesar de la prevalencia de deepfakes pornográficos (Ajder et al., 2019, Home Security Heroes, 2023), la atención pública y crítica a menudo se concentra desproporcionadamente en deepfakes políticos, minimizando el daño perpetrado con la pornografía falsa. En el caso de las mujeres políticas, estas invasiones de la privacidad sexual y formas de abuso sexual basadas en las imágenes (Citron 2018; Powell et al., 2018; Franks 2016; McGlynn y Rackley, 2017) de consecuencias devastadoras para las víctimas (Siegemund-Broka, 2013; Citron, 2019; Melville, 2019), además de reforzar las normas y estructuras de poder existentes al objetivizar a las mujeres y desafiar su credibilidad (Andone 2019).

En este sentido, siguiendo a Krook y Retrepo (2016) resulta preciso hablar de la violencia contra las mujeres en política como un fenómeno específico y diferente de otras formas de violencia machista ya que, pretende impedir, castigar o privar su participación política, por el hecho de ser mujeres (South Asia Partnership International, 2006).

Maddocks (2020) constató que algunos creadores de deepfakes emplean deliberadamente vídeos manipulados para silenciar a personalidades destacadas. Si, como señalan Newton y Stanfill (2020) en la comunidad deepfake se pone de manifiesto una masculinidad tóxica geek, que propaga la invasión de la privacidad y la explotación sexual en línea, su creación, así como otras formas de manipulación de imagen, van a tener como principal objeto las mujeres y –dentro de éstas– aquellas de mayor proyección pública como las políticas.

En este sentido el objeto del presente trabajo ha sido el de analizar las prácticas habituales de manipulación de imágenes de las que son víctimas las políticas españolas, como parte de la violencia contra las mujeres en política.

3. METODOLOGÍA

Para abordar las formas de manipulación a las que se ven sometidas las imágenes de las mujeres se ha desarrollado un estudio en tres etapas, cada una con técnicas de recogida de información diferente.

Dentro del proyecto AGITATE: asimetrías de género en la comunicación política digital, en el que se inscribe el presente estudio se llevaron a cabo quince entrevistas en profundidad con líderes y representantes políticas de diversos partidos y ámbitos (nacional-autonómico-local). En las que se desgranaron las diferentes formas de violencia digital a las que se enfrentan en su día a día en la red, así como sus percepciones respecto al género como un factor explicativo.

Si bien no existe consenso a la hora de determinar si la violencia a la que se enfrentan las mujeres políticas es mayor que la de sus homólogos masculinos, todas las entrevistados señalaron la especificidad de la violencia: “A los hombres se les ataca más por aquello que dicen, a las mujeres por lo que representan”, “ataca a lo privado”, “a lo más íntimo”, algunas de ellas inciden también en la objetivización y sexualización, impensable en los políticos masculinos.

El siguiente paso fue el de centrarnos en el ámbito específico de la imagen, a las que algunas de ellas hicieron relevancia durante la entrevista. Señalan haber sido objeto de memes, de manipulaciones de imágenes para destacar algún rasgo físico, de hipersexualización e incluso señalan haber sido testigos de sucesos que luego fueron reinterpretados gracias a la manipulación de imágenes.

Teniendo en cuenta que las imágenes falsas o manipuladas se han convertido en una parte fundamental del trabajo de verificación de noticias, se ha acudido a los contenidos basados en imágenes identificados como falsos por factcheckers como Newtral, Maldita o VerificaRTVE.

Dado el carácter exploratorio de esta investigación, se ha optado por la selección de aquellas imágenes clasificadas como falsas que implicasen a mujeres del ámbito de la política, en lugar de hacer una acotación temporal para un análisis sistemático de la información.

Por ello, aunque se ha desarrollado una perspectiva extensiva del concepto de políticas que incluye a líderes, candidatas, representantes, militantes o activistas, el enfoque hacia los verificadores de noticias ha restringido introducido un duplo sesgo en las imágenes de estudio: centrándose fundamentalmente en políticas de ámbito nacional y en integrantes del Ejecutivo central, representantes y líderes con mayor visibilidad pública máxime en un año, como el 2023, marcado por las citas electorales y las negociaciones políticas.

En la misma línea, la búsqueda en páginas y plataformas de deepfakes para adultos se centró fundamentalmente en políticas de ámbito nacional, dada la imposibilidad de abarcar a todos los nombres y personalidades de la política local.

4. RESULTADOS Y DISCUSIÓN

El estudio llevado a cabo ha permitido constatar la limitada sofisticación en la manipulación de imágenes de mujeres políticas. En un contexto en la que se ha multiplicado el empleo de la inteligencia artificial para el reemplazo de rostros, la imitación de expresiones faciales o el tratamiento imagen-sonido, la mayoría de las imágenes catalogadas como falsas podrían ser detectadas por una audiencia crítica haciendo una búsqueda inversa en Google o revisando otras imágenes del mismo evento, por ejemplo.

De tomar como referencia la clasificación propuesta por Gómez-de-Ágreda et al. (2021) la mayoría de las imágenes revisadas por los verificadores se corresponderían con imágenes parciales, seguidas por aquellas imágenes con retoque básico y las descontextualizadas. Todas ellas manifestaciones de cheapfakes.

Figura 14: Imagen descontextualizada. Ministra de Igualdad e integrantes de su equipo en Times Square.

Fuente: Vocento.

En julio de 2022 se difundieron unas instantáneas de Irene Montero y su equipo en Nueva York. Con ellas se extendió la idea de que se trataba de un viaje “de placer” potenciando la visibilización de las fotografías casuales y desenfadadas en detrimento de la agenda de actos oficiales e institucionales.

Figura 15: Imagen parcial. El “pico” entre Yolanda Díaz y Pedro Sánchez.

Fuente: Maldita.

El saludo del presidente del Ejecutivo Español, Pedro Sánchez, y la líder de Sumar, Yolanda Díaz, en una sesión de Congreso de abril de 2022, se convirtió en una imagen diferente -más afectuosa- gracias a la perspectiva de la que fue tomada. Esta imagen volvió a difundirse en agosto de 2023, tras el llamado “Caso Rubiales”.

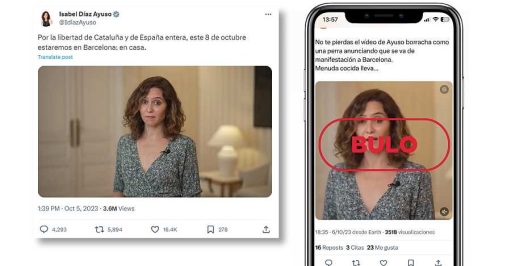

Figura 16: Retoque básico de vídeo: Isabel Díaz Ayuso ebria.

Fuente: Verifica RTVE.

Al igual que Nancy Peloso y Patricia Bullrich, circularon vídeos de la presidenta madrileña Isabel Díaz Ayuso y de la ministra de Trabajo y líder de la plataforma de izquierdas Sumar, en los que un retoque en la velocidad del vídeo sugería un claro estado de ebriedad.

Figura 17: Retoque digital de imágenes: Voto de Ángela Rodríguez, secretaria de Estado de Igualdad y contra la Violencia de Género.

Fuente: Maldita.

En la papeleta se incluye el nombre de Irene Montero como si Ángela Rodríguez la incluyese en su voto como cabeza de lista de Sumar.

Figura 18: Retoque digital de imágenes: hipersexualización de la presidenta de la Comunidad de Madrid, Isabel Díaz Ayuso.

Fuente: Maldita.

En el caso de los deepfakes se puede apreciar una orientación al ámbito concreto de la pornografía. Aun cuando se puede presumir la existencia de otras imágenes sintéticas o modificadas sintéticamente que han pasado desapercibidas para los verificadores o que, pese a estar bajo sospecha, les falte herramientas para su identificación como falsas, es en las plataformas de pornografía donde se encuentran más manifestaciones de deepfakes de mujeres políticas. Aunque se pueden señalar algunas excepciones, como el vídeo fake de Macarena Olona bailando como Shakira, Las fórmulas más habituales que encontramos para esta violación de la intimidad de estas mujeres, a través de la hipersexualización y el desarrollo de pornografía no consentida son: el (reemplazo de caras o cambiar el rostro de una persona por otra, y la réplica de expresiones faciales, que suelen aportar realismo a la copia en piezas audiovisuales.

La creación de estos deepfakes van más allá de fantasías de intimidad con celebridades (Hayward y Rahn 2015), para suponer ejercicios de humillación y represalias públicas por su atractivo sexual (Newton y Stanfill, 2019) pero -en el caso de las mujeres políticas- por su transgresión al tomar la palabra en el espacio público-político.

Figuras 19-21: Reemplazo de rostros de la líder de Caminando Juntos, Macarena Olona, y una joven bailando una coreografía de Shakira.

Fuente: @Clorazepamer.

Figuras 22: Deepfake pornográfico: Reemplazo de rostros entre la líder de Ciudadanos, Inés Arrimadas, y una actriz porno.

Fuente: MrDeepfake.

En algunos casos esta “porno venganza” se basa en métodos menos sofisticados como la descontextualización de imágenes. Así sucedió en el caso de la ministra de Igualdad, Irene Montero, y la líder de Ciudadanos, Inés Arrimada, que fueron identificadas subrepticiamente en plataformas digitales con sendas dobles: una sexóloga y una actriz porno.

Figuras 23: Descontextualización: la supuesta Irene Montero sexóloga.

Fuente: VerificaRTVE.

Si atendemos a la orientación de su contenido resulta destacable que, más que la política, estas imágenes se integran dentro de la desinformación –la desinformación de género (Piñeiro-Otero y Martínez-Rolán, 2022)– e incluso en la pornografía.

Como incidía una de las entrevistadas, si bien de forma aislada estas fake news “pueden parecer divertidas de tan grotescas que son (...) es una estrategia de lluvia fina para desprestigiarte”.

Así es frecuente que estas imágenes se cataloguen como falsas noticias, término con el que Gómez-de-Ágreda et al. (2021) inciden en la importancia de que –en el contexto actual– adquieren determinados contenidos sin valor noticioso. En un momento de excesiva polarización de la opinión pública en España, el incremento de estas falsas noticias y su libre circulación a través de redes sociales buscan impactar y apelar a la emoción (Dafonte-Gómez, 2014) más que a la razón, para suscitar y reforzar determinados posicionamientos.

Una de las políticas entrevistadas hacía una reflexión sobre este aspecto señalando que “las ‘soft politics’ (…) las noticias y la información sobre elementos banales, desplazan el debate sobre sobre las ‘hard politics’ sobre las políticas reales (…) los elementos que operan sobre la transformación material de la realidad social.”

Pero en el caso de las políticas podemos ir más allá, para vincular estas falsas noticias con una tradición mediática que da un tratamiento sesgado –más trivial y familiar que el de sus colegas varones (Sánchez-Calero et al., 2013; Palmer y Simon, 2005)– en la que son frecuentes referencias al atuendo y a la apariencia física que empañan las propias acciones y declaraciones de las representantes políticas.

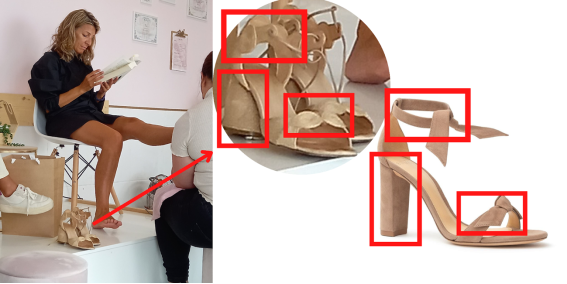

En este sentido algunas de las falsas noticias se vinculan al aspecto y complementos de las mujeres políticas, como una forma de desprestigiar su imagen e incluso sus posicionamientos ideológicos.

Fuente: Newtral.

Fotografía de la comparecencia de Irene Montero en la Comisión de Igualdad, en octubre de 2021, para dar cuenta de varios proyectos en marcha de su Ministerio, como el de la ley de Garantía Integral de la Libertad Sexual. La perspectiva desde la que está tomada, sitúa al lado de Montero un bolso de marca que –en realidad– se encontraba tras ella. Que una ministra tenga un bolso de dos mil euros, de la firma Louis Vuitton, supuso un ejemplo de cómo el ruido y los flujos de información que alimentan la polarización política se basan en falsas noticias.

Figura 25: Imagen descontextualizada. El calzado de lujo de Yolanda Díaz. Imagen y trabajo de verificación.

Fuente: Newtral.

Identificación errónea e interesada del modelo-marca de calzado de la ministra de trabajo.

En este sentido la manipulación de imágenes pone de manifiesto que este problema no es nuevo, ni puntual, sino que es algo cultural, reflejo de estereotipos de género y las relaciones de poder que se establecen dentro y fuera de la Red.

5. CONCLUSIONES

La irrupción de los deepfakes y otras técnicas de manipulación de imágenes en el ámbito político y social constituye un desafío mayúsculo para la veracidad informativa. En un panorama en el que la percepción del público puede verse distorsionada por la fluidez con que se presentan estos contenidos, independientemente de su fidelidad a la realidad, como alertan Vaccari y Chadwick (2020), se hace patente la urgencia de desarrollar estrategias efectivas para su identificación. No obstante, resulta aún más imperioso robustecer la educación mediática de la ciudadanía. Confrontar el sesgo de confirmación, ese impulso que nos lleva a aceptar solo aquello que resuena con nuestras convicciones previas, representa una tarea ardua, pero indispensable. Y es que, tal como postula Yvorsky (2019), cultivar una ciudadanía dotada de espíritu crítico es esencial para fomentar un análisis reflexivo del torrente informativo que nos asedia.

Las imágenes alteradas, cargadas de emociones intensas, se erigen como herramientas ideales para una difusión veloz y desenfrenada, alimentando así la polarización política y minando la confianza en medios e instituciones, una dinámica que Fard y Lingeswaran (2020) han documentado minuciosamente. Esta problemática se agudiza cuando se dirige a mujeres políticas, cuya integridad y participación son objeto de ataques exacerbados en ciertos nichos digitales que menosprecian la diversidad y perpetúan nociones anacrónicas sobre género y sexualidad. Massanari (2017) advierte que tales actitudes son manifestaciones de una resistencia violenta y sostenida contra el avance femenino en esferas tecnológicas y públicas. En este entorno hostil, la llamada masculinidad tóxica geek, que Newton y Stanfill (2020) han descrito como una forma de poder que margina y subyuga a las mujeres, se hace particularmente evidente en la agresión hacia aquellas que desafían los cánones patriarcales.

Por tanto, es imperativo comprender que la proliferación de imágenes manipuladas de mujeres políticas, muchas veces con la intención de menoscabar su reputación, se inscribe en un contexto de lucha de poder en el que se entrelazan ideologías misóginas y relatos ficticios (Ferrier, 2018; Cuthbertson et al., 2019). Estas prácticas, que a menudo confluyen en actos de pornovenganza, se utilizan como arma para silenciar las voces disidentes, en un esfuerzo por preservar las estructuras de poder establecidas. No es casual que estos deepfakes y cheapfakes se hayan centrado en aquellas mujeres con mayor preeminencia como Yolanda Díaz e Inés Arrimadas, líderes de fuerzas políticas, o la Presidenta de la Comunidad de Madrid Isabel Díaz Ayuso. En el caso de Irene Montero o Ángela Rodríguez más allá de la visibilidad pública, se debe hacer referencia a su carácter de símbolos de las políticas de igualdad y -por tanto- son víctimas propicias de ataques misóginos en busca de desacreditarlas y denostar su labor.

Deepfakes y cheapfakes suponen una forma de represión, para silenciar a las mujeres y recluirlas en determinados espacios soft de la política, donde sus acciones y discursos quedan ocultos tras un halo de frivolidad y de falsas noticias.

6. REFERENCIAS

Abuín-Penas, J. y Abuín-Penas, R. (2022). Redes sociales y el interés por la información oficial en tiempos de pandemia: análisis de la comunicación de los ministerios de salud europeos en Facebook durante la COVID-19. Revista de Comunicación y Salud, 12, 59-76. https://doi.org/10.35669/rcys.2022.12.e303

Ajder, H., Patrini, G., Cavalli, F. y Cullen, L. (2019). The state of deepfakes: landscape, threats, and impact. https://regmedia.co.uk/2019/10/08/deepfake_report.pdf

Almansa-Martínez, A., Fernández-Torres, M. J. y Rodríguez-Fernández, L. (2022). Desinformación en España un año después de la COVID-19: Análisis de las verificaciones de Newtral y Maldita. Revista Latina de Comunicación Social, 80, 183-200. https://doi.org/10.4185/RLCS-2022-1538

Alonso-González, M. (2021). Desinformación y coronavirus: el origen de las fake news en tiempos de pandemia. Revista de Ciencias de la Comunicación e Información, 26, 1-25. https://doi.org/10.35742/rcci.2021.26.e139

Amoedo, A. (2023). Disminuye el consumo de noticias en medios digitales y se estabiliza el uso de las fuentes tradicionales offline. Digital News Report España 2023. https://acortar.link/uPmSQX

Andone, D. (2019). Bella Thorne shares nude photos on Twitter after a hacker threatened to release them. CNN. https://www.cnn.com/2019/06/15/entertainment/bella-thorne-nude-photos-hack/index.html

Angler, M. (2021). Fighting abusive deepfakes: the need for a multi-layered action plan. European Science-Media Hub. https://sciencemediahub.eu/

Ayyub, R. (2018). I was the victim of a deepfake porn plot intended to silence me. The Huffington Post. R https://www.huffingtonpost.co.uk/entry/deepfake-porn_uk_5bf2c126e4b0f32bd58ba316

Bakir, V. y McStay, A. (2018). Fake news and the economy of emotions: problems, causes, solutions. Digital Journalism, 6(2), 154-175. https://doi.org/10.1080/21670811.2017.1345645

Barca, K. (2020). Google lanza Assembler, una herramienta para identificar imágenes falsas y combatir la desinformación en los medios. Business Insider. https://acortar.link/vBYRvV

Barnes, C. y Barraclough, T. (2019). Perception inception: Preparing for deepfakes and the synthetic media of tomorrow. The Law Foundation.

Barrientos-Báez, A. y Caldevilla-Domínguez, D. (2022). La mujer y las Relaciones públicas desde un alcance neurocomunicacional. Revista Internacional de Relaciones Públicas, 12(24), 85-102. https://doi.org/10.5783/revrrpp.v12i24.791

Barrientos-Báez, A., Caldevilla-Domínguez, D. y Yezers’ka, L. (2022). Fakenews y posverdad: relación con las redes sociales y fiabilidad de contenidos. Fonseca, Journal of Communication, 24, 149-162. https://doi.org/10.14201/fjc.28294

Barrientos-Báez, A., Martínez-Sala, A., Altamirano, V. y Caldevilla-Domínguez, D. (2021). Fake news: la pandemia de la COVID-19 y su cronología en el sector turístico. Historia y Comunicación Social, 26(Especial), 135-148. https://doi.org/10.5209/hics.74248

Beamonte, P. (2018). FakeApp, el programa de moda para crear vídeos porno falsos con IA. Hipertextual. https://hipertextual.com/2018/01/fakeapp-videos-porno-falsos-ia

Bellovary, A. K., Young, N. A. y Goldenberg, A. (2021). Left-and right-leaning news organizations use negative emotional content and elicit user engagement similarly. Affective Science, 2(4), 391-396. https://doi.org/10.1007/s42761-021-00046-w

Bonet-Martí, J. (2020). Análisis de las estrategias discursivas empleadas en la construcción de discurso antifeminista en redes sociales. Psicoperspectivas, 19(3), 52-63. http://dx.doi.org/10.5027/psicoperspectivas-vol19-issue3-fulltext-2040

Bonet-Martí, J. (2021). Los antifeminismos como contramovimiento: una revisión bibliográfica de las principales perspectivas teóricas y de los debates actuales. Teknokultura. Revista de Cultura Digital y Movimientos Sociales, 18(1), 61-71. https://doi.org/10.5209/tekn.70225

Brown, W. y Fleming, D. H. (2020). Celebrity headjobs: Or oozing squid sex with a framed-up leaky . Porn Studies, 7(4), 357-366. http://dx.doi.org/10.1080/23268743.2020.

Caldevilla-Domínguez, D. (2014). Impacto de las TIC y el 2.0: consecuencias para el sector de la comunicación. Revista de Comunicación de la SEECI, 35, 106-127. https://doi.org/10.15198/seeci.2014.35.106-127

Cerdán-Martínez, V., García-Guardia, M. L. y Padilla-Castillo, G. (2020). Alfabetización moral digital para la detección de deepfakes y fakes audiovisuales. CIC. Cuadernos de Información y Comunicación, 25, 165-181. https://doi.org/10.5209/ciyc.68762

Chesney, R. y Citron, D. (2018). Deep Fakes: A Looming Challenge for Privacy, Democracy, and National Security. California Law Review, 107, 1755-1820. http://dx.doi.org/10.2139/ssrn.3213954

Citron, D. K. (2019). The National Security Challenge of Artificial Intelligence, Manipulated Media, and “Deep Fakes”. House Permanent Select Committee on Intelligence. https://intelligence.house.gov/calendar/eventsingle.aspx?EventID=653

Cole, K. K. (2015). "It’s Like She's Eager to be Verbally Abused": Twitter, Trolls, and (En)Gendering Disciplinary Rhetoric. Feminist Media Studies, 15(2), 356-358. https://doi.org/10.1080/14680777.2015.1008750

Compton, S. (2021). More women are facing the reality of deepfakes, and they’re ruining lives. Vogue. https://www.vogue.co.uk/news/article/stop-deepfakes-campaign

Cosentino, G. (2020). Social Media and the Post-Truth World Order: The Global Dynamics of Disinformation. Springer Nature.

Cuthbertson, L., Kearney, A., Dawson, R., Zawaduk, A., Cuthbertson, E., Gordon-Tighe, A. y Mathewson, K. W. (2019). Women, politics and Twitter: using machine learning to change the discourse. https://doi.org/10.48550/arXiv.1911.11025

Dafonte-Gómez, A. (2014). Claves de la publicidad viral: De la motivación a la emoción en los vídeos más compartidos. Comunicar, 21(43), 199-206. http://dx.doi.org/10.3916/C43-2014-20

Dawkins, R. (2006). The Selfish Gene (3rd ed.). Oxford University Press.

DEEPTRACE (2019). The state of Deepfakes. Landscape Threads and Impact. https://regmedia.co.uk/2019/10/08/deepfake_report.pdf

del Castillo, C. (2020). Un candidato que intenta captar votos en una lengua que no habla: los deepfakes políticos ya están aquí. El Diario.es. https://acortar.link/wle9aF

Denson, S. (2020). Discorrelated images. Duke University Press.

Diakopoulos, N. y Johnson, D. (2020). Anticipating and addressing the ethical implications of deepfakes in the context of elections. New Media & Society, 23(7), 1-27. https://doi.org/10.1177/1461444820925811

ElDiarioes [elDiario.es] (2020, July 24). Ocasio-Cortez responde a los insultos machistas de un congresista: "Esto no es puntual, es cultural" [video]. YouTube. https://www.youtube.com/watch?v=x0Qt-zF6oAw

Encinillas-García, M. y Martín-Sabarís, R. (2023). Desinformación y salud en la era pre-COVID: Una revisión sistemática. Revista de Comunicación y Salud, 13, 1-15. https://doi.org/10.35669/rcys.2023.13.e312

Facebook Newsroom. (2020). Enforcing Against Manipulated Media. https://about.fb.com/news/2020/01/enforcing-against-manipulated-media/

Fard, A.-E. y Lingeswaran, S. (2020). Misinformation battle revisited: Counter strategies from clinics to artificial intelligence. En Proceedings of the WWW’20. https://doi.org/10.1145/3366424.3384373

Farid, H., Gu, Y., He, M., Nagano, K. y Li, H. (2019). Protecting world leaders against deep fakes. En proceedings of the IEEE Conference on Computer Vision and Pattern Recognition Workshops (pp. 38-45). https://acortar.link/xA6CK1

Farkas, J. y Schou, J. (2018). Fake News as a Floating Signifier: Hegemony, Antagonism and the Politics of Falsehood, Javnost. The Public, 25(3), 298-314. https://doi.org/10.1080/13183222.2018.1463047

Ferrier, M. (2018). Attacks and Harassment: The impact on female journalists and their reporting. International Women's Media Foundation & Trollbusters. www.iwmf.org/attacks-and-harassment/

Fiorina, M. P., Abrams, S. J. y Pope, J. C. (2006). Culture War? The Myth of a Polarized America. Pearson.

France, L. R. (2018). Fans rally around Bella Thorne after sexual abuse revelation. CNN. https://www.cnn.com/2018/01/09/entertainment/bella-thorne-sexual-abuse/index.html

Franks, M. A. (2016). 'Revenge Porn' Reform: A View from the Front Lines. Florida Law Review, 69(5). https://repository.law.miami.edu/fac_articles/572/

García-Escribano, J. J., García-Palma, M. B. y Manzanera-Román, S. (2021). La polarización de la ciudadanía ante temas posicionales de la política española. Revista Más Poder Local, 45, 57-73. https://acortar.link/qw5xOT

García-Mingo, E., Díaz Fernández, S. y Tomás-Forte, S. (2022). (Re)configurando el imaginario sobre la violencia sexual desde el antifeminismo: el trabajo ideológico de la manosfera española. Política y Sociedad, 59(1), e80369. http://dx.doi.org/10.5209/poso.80369

García-Orosa, B. (2021). Disinformation, social media, bots, and astroturfing: the fourth wave of digital democracy. Profesional de la Información, 30(6), e300603. https://doi.org/10.3145/epi.2021.nov.03

Garimella, K. y Eckles, D. (2020). Images and misinformation in political groups: Evidence from WhatsApp in India. Misinformation Review, 1(5). https://doi.org/10.37016/mr-2020-030

Garmendia Madariaga, A., Lorenzo-Rodríguez, J. y Riera, P. (2022). Construyendo bloques: la promiscuidad política online en tiempos de polarización en España. Revista Española de Investigaciones Sociológicas, 178, 61-82. http://dx.doi.org/10.5477/cis/reis.178.61

Gerardi, F., Walters, N. y James, T. (2020). Cyber-security implications of deepfakes. University College London. NCC Group.

Ging, D. y Siapera, E. (2019). Gender hate online: Understanding the New Anti-feminism. Palgrave Macmillan.

Gómez-de-Ágreda, Á. (2020). Ethics of autonomous weapons systems and its applicability to any AI systems. Telecommunications Policy, 44(6). https://doi.org/10.1016/j.telpol.2020.101953

Gómez-de-Ágreda, Á., Feijóo, C. y Salazar-García, I. A. (2021). Una nueva taxonomía del uso de la imagen en la conformación interesada del relato digital. Deep fakes e inteligencia artificial. El Profesional de la Información, 30(2), e300216. https://doi.org/10.3145/epi.2021.mar.16

Hallinan, B. y Striphas, T. (2016). Recommended for you: The Netflix prize and the production of algorithmic culture. New Media & Society, 18(1), 117-137. https://doi.org/10.1177/1461444814538646

Hao, K. (2022). Google has released a tool to spot faked and doctored images. MIT Technology Review. https://acortar.link/as9I9z

Hartman, T. y Satter, R. (2020). These faces are not real. Reuters Graphics. https://graphics.reuters.com/CYBER-DEEPFAKE/ACTIVIST/nmovajgnxpa/index.html

Harwell, D. (2018). White House shares doctored video to support punishment of journalist Jim Acosta. The Washington Post. https://wapo.st/3cytr6C

Hayward, P. y Rahn, A. (2015). Opening Pandora’s Box: Pleasure, Consent and Consequence in the Production and Circulation of Celebrity Sex Videos. Porn Studies, 2(1), 49-61. https://doi.org/10.1080/23268743.2014.984951

Heemsbergen, L., Treré, E. y Pereira, G. (2022). Introduction to algorithmic antagonisms: Resistance, reconfiguration, and renaissance for computational life. Media International Australia, 183(1), 1-13. https://doi.org/10.1177/1329878X221086042

Home Security Heroes (2023). State Of Deepfakes: Realities, Threats, And Impact. www.homesecurityheroes.com/state-of-deepfakes/

Hybridas (2021). La violencia política por razón de género en España. https://acortar.link/F9KUKC

Jacobsen, B. N. y Simpson, J. (2023). The tensions of deepfakes. Information, Communication & Society. https://doi.org/10.1080/1369118X.2023.2234980

Jaubert, A. (1989). Making People Disappear. Pergamon-Brassey´s.

Keyes, R. (2004). The post-truth era: Dishonesty and deception in contemporary life. St. Martin's Press.

Kietzmann, J., Lee, L. W., McCarthy, I. P. y Kietzmann, T. (2020). Deepfakes: Trick or Treat?, Business Horizons, 63(2), 135-146. https://doi.org/10.1016/j.bushor.2019.11.006

Krizhevsky, A., Sutskever, I. y Hinton, G. E. (2017). ImageNet classification with deep convolutional neural networks. Communications of the ACM, 60(6). https://doi.org/10.1145/3065386

Krook, M. L. y Restrepo, J. (2016). Violencia contra las mujeres en política. Política y Gobierno, 23(2), 459-490. https://acortar.link/PlrwE7

Levy, P. (2004). Inteligencia colectiva: por una antropología del ciberespacio. Centro Nacional de Información de Ciencias Médicas [INFOMED]. https://acortar.link/po9jLK

Lone, A. A. y Bhandari, S. (2020). Mapping Gender-based Violence through ‘Gendertrolling’. National Dialogue on Gender-based Cyber Violence. https://acortar.link/RDIOpx

López-del-Castillo-Wilderbeek, F. L. (2021). El seguimiento sobre las fake news en medios institucionales durante el coronavirus en España. Vivat Academia, 154, 1-12. https://doi.org/10.15178/va.2021.154.e1253

López Iglesias, M., Tapia-Frade, A. y Ruiz Velasco, C. M. (2023). Patologías y dependencias que provocan las redes sociales en los jóvenes nativos digitales. Revista de Comunicación y Salud, 13, 1-22. https://doi.org/10.35669/rcys.2023.13.e301

López-Borrull, A., Vives-Gràcia, J. y Badell, J.-I. (2018). Fake news, ¿Amenaza u oportunidad para los profesionales de la información y la documentación?. El Profesional de la Información, 27(6), 1346-1356. https://doi.org/10.3145/epi.2018.nov.17

Maddocks, S. (2020). ‘A Deepfake Porn Plot Intended to Silence Me’: Exploring continuities between pornographic and ‘political’ deep fakes. Porn Studies. https://doi.org/10.1080/23268743.2020.1757499

Manfredi-Sánchez, J. L. (2021). El impacto de COVID-19 en la narrativa estratégica internacional. Instituto Español de Estudios Estratégicos. https://acortar.link/QPJBdF

Manne, K. (2018). Down girl: the logic of misogyny. Oxford University Press.

Mantilla, K. (2013). Gendertrolling: misogyny adapts to new media. Feminist Studies, 39(2). https://www.jstor.org/stable/23719068

Martínez-Sánchez, J. A. (2022). Prevención de la difusión de fake news y bulos durante la pandemia de COVID-19 en España. De la penalización al impulso de la alfabetización informacional. Revista de Ciencias de la Comunicación e Información, 27, 15-32. https://doi.org/10.35742/rcci.2022.27.e236

Massanari, A. (2017). #Gamergate and the fappening: how reddit’s algorithm, governance, and culture support toxic technocultures. New Media & Society, 19(3), 329-346. https://doi.org/10.1177/14614448156088

McComiskey, B. (2017). Post-Truth Rhetoric and Composition. University Press of Colorado.

McGlynn, C., Rackley, E. y Houghton, R. (2017). Beyond ‘revenge porn’: The continuum of image-based abuse. Feminist Legal Studies, 25(1), 25-46. https://doi.org/10.1007/s10691-017-9343-2

Melville, K. (2019). ‘Humiliated, Frightened and Paranoid’: The Insidious Rise of Deepfake Porn. ABC News. https://acortar.link/2uYkzm

Miller, M. N. (2020). Digital threats to democracy: A double-edged sentence. Technology for Global Security. CNAS. https://acortar.link/dWpD3x

Mohan, M. y Eldin, Y. (2019). The real (and fake) sex lives of Bella Thorne. BBC. https://www.bbc.com/news/stories-50072653

Morris, I. (2018). Revenge porn gets even more horrifying with deepfakes. Forbes. https://acortar.link/Qneid0

Mula-Grau, J. y Cambronero-Saiz, B. (2022). Identificación de las fake news que se publican en la edición en papel de un diario provincial en la era de la desinformación digital de Trump y el inicio del COVID. Vivat Academia, 155, 23-38. https://doi.org/10.15178/va.2022.155.e1329

Mulvey, L. (1978). Placer visual y cine narrativo. https://acortar.link/EjrhV1

Nagle, A. (2017). Kill all normies: online culture wars from 4chan and tumbler to trump and the alt-right. Zero Books.

Newton, O. B. y Stanfill, M. (2019). My NSFW video has partial occlusion: deepfakes and the technological production of non-consensual pornography. Porn Studies. https://doi.org/10.1080/23268743.2019.1675091

Nightingale, S. J. y Farid, H. (2022). AI-synthesized faces are indistinguishable from real faces and more trustworthy. PNAS Journal, 119(8), e2120481119. https://doi.org/10.1073/pnas.2120481119

Nuevo-López, A., López-Martínez, F. y Delgado-Peña, J. J. (2023). Bulos, redes sociales, derechos, seguridad y salud pública: dos casos de estudio relacionados. Revista de Ciencias de la Comunicación e Información, 28, 120-147. https://doi.org/10.35742/rcci.2023.28.e286

Organización Panamericana de la Salud [OPS] (2020). Entender la infodemia y la desinformación en la lucha contra la COVID-19. Caja de herramientas: transformación digital. https://iris.paho.org/bitstream/handle/10665.2/52053/Factsheet-Infodemic_spa.pdf

Orte, C., Sánchez-Prieto, L., Caldevilla-Domínguez, D. y Barrientos-Báez, A. (2020). Evaluation of distress and risk perception associated with COVID-19 in vulnerable groups. International Journal of Environmental Research and Public Health, 17(24). https://doi.org/10.3390/ijerph17249207

Paananen, A. y Reichl, A. J. (2019). Gendertrolls just want to have fun, too. Personality and Individual Differences, 141, 152-156. https://doi.org/10.1016/j.paid.2019.01.011

Palmer, B. y Simon, D. (2005). When women run against women: the hidden influence of female incumbents in elections to the U.S. house of representatives, 1956-2002. Cambridge University Press.

Paris, B. y Donovan, J. (2019). Deepfakes and Cheap Fakes: The Manipulation of Audio and Visual Evidence. Data & Society Research Institute. https://datasociety.net/output/deepfakes-and-cheap-fakes/

Patrini, G., Cavalli, F. y Ajder, H. (2018). The state of deepfakes: reality under attack. Annual Report, 2(3). https://acortar.link/tZ9Eyy

Piñeiro-Otero, T. y Martínez-Rolán, X. (2021). Eso no me lo dices en la calle. Análisis del discurso del odio contra las mujeres en Twitter. Profesional de la Información, 30(5). https://doi.org/10.3145/epi.2021.sep.12

Piñeiro-Otero, T., Martínez-Rolán, X. y Castro, L. (2023). ¿Sueñan los troles con mujeres en el poder? Una aproximación al troleo de género como violencia política. [Comunicación presentada al congreso Meis Studes]. Brasil.

Powell, A., Flynn, A. y Henry, N. (2018). AI Can Now Create Fake Porn, Making Revenge Porn Even More Complicated. The Conversation. The Conversation. https://acortar.link/tZ9Eyy

Randall, N. (2022). The rise of shallowfakes. The Journal. The voice of your profession. https://thejournal.cii.co.uk/2022/10/20/rise-shallowfakes